Proč právě 24 GB?

Na první pohled to vypadá jako náhodné číslo. Ve skutečnosti jde o první přirozenou hranici, kde se na běžném hardwaru vejdou takzvané 27B až 31B husté modely — tedy neuronové sítě s 27 až 31 miliardami parametrů. To je kategorie, která ještě před nedávnem patřila výhradně do datacenter. Dnes se s ní setkáváme v domácích pracovnách.

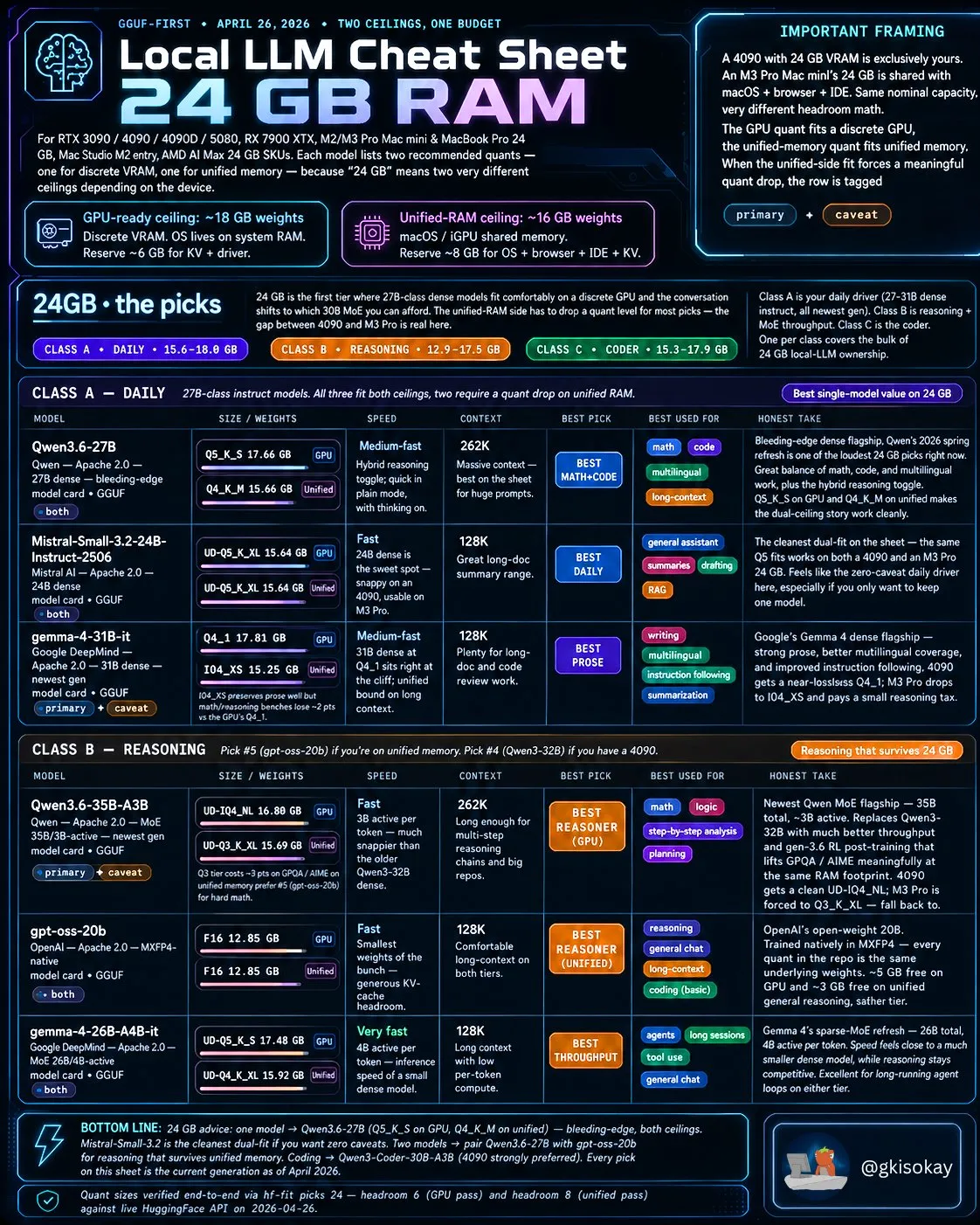

Autor přehledu, známý pod přezdívkou @gkisokay, dělí zařízení do dvou táborů. První jsou klasické herní grafiky s dedikovanou videopamětí — například RTX 3090, RTX 4090, RTX 5080 nebo RX 7900 XTX. Ty nabídnou zhruba 18 GB volných pro samotný model, protože operační systém a ovladače žijí na zvláštní systémové RAM. Druhý tábor tvoří Apple počítače s unified memory — Mac mini M2/M3 Pro, MacBook Pro 24 GB nebo Mac Studio. Tam se o paměti dělí celý systém včetně prohlížeče a vývojového prostředí, takže na model zbývá přibližně 16 GB. A právě tento rozdíl určuje, kterou kvantizovanou verzi modelu si můžete dovolit.

Co je kvantizace a proč na ní záleží?

Každý velký jazykový model je v původní podobě obrovský soubor čísel — parametrů. U modelu s 30 miliardami parametrů v plné přesnosti (16bit) byste potřebovali přes 60 GB paměti. To je nad možnosti běžného hardwaru. Kvantizace znamená, že se tyto parametry zmenší na nižší přesnost — třeba 4 bity místo 16. Výsledkem je model, který zabere čtvrtinu místa, přičemž ztráta kvality je často minimální, zejména u moderních metod jako Q4_K_M nebo Q5_K_S.

Právě volba kvantizace rozhoduje, jestli model naskočí, nebo se váš počítač začne dusit. Cheat sheet proto pro každý model uvádí doporučenou kvantizaci jak pro GPU s dedikovanou VRAM, tak pro unified-memory systémy.

Class A: Denní řidič — modely pro každodenní použití

Do této kategorie spadají tři silné kandidáti, kteří mají jedno společné: jsou to husté (dense) modely, které nepotřebují žádné složité triky jako směs expertů. Všechy tři se vejdou do obou typů paměti, i když na Macu s unified memory občas musíte sáhnout po o něco nižší kvantizaci.

Qwen 3.6 27B

Alibabův vlajkový model je vnímán jako nejlepší kompromis matematiky, kódu a vícejazyčnosti v této třídě. V kvantizaci Q5_K_S zabere na GPU 17,66 GB, na unified systému stačí Q4_K_M s 15,66 GB. Má kontextové okno 262 tisíc tokenů, což znamená, že mu můžete najednou podsunout celou technickou dokumentaci nebo dlouhý právní text a model se v něm neztratí. Pro české uživatele je zajímavé, že rodina Qwen má silnou podporu češtiny a slovenských jazykových variant.

Mistral Small 3.2 24B

Francouzská společnost Mistral AI postavila tento model jako čistokrevného denního pomocníka. Ve verzi UD-Q5_K_XL zabere 15,64 GB na obou platformách, což z něj dělá nejčistší dvojí zásah v celém přehledu. Je rychlý, má kontext 128 tisíc tokenů a exceluje v shrnování dlouhých dokumentů a generování textů. Pokud chcete mít na disku jen jeden model, který zastane vše od chatu po přepis poznámek, Mistral Small je podle autora přehledu ta nejbezpečnější sázka.

Gemma 4 31B

Google DeepMind svou vlajkovou Gemmu 4 nabízí v konfiguraci 31B jako nejlepší volbu pro psaní a vícejazyčný překlad. Na dedikované grafice běží v kvantizaci Q4_1 (17,81 GB), na Macu musíte sáhnout po I-Q4_XS (15,25 GB), což s sebou nese mírný daň v podobě drobného poklesu matematických schopností. Přesto jde o skvělý model pro redaktory, copywritery nebo studenty, kteří potřebují jazykově jistého parťáka. Gemma 4 má rovněž velmi dobrou podporu evropských jazyků včetně češtiny.

Class B: Reasoning — když potřebujete přemýšlet

Druhá třída je určena pro uživatele, kteří od modelu chtějí logické řetězce, matematickou analýzu nebo plánování složitých úkolů. Zde už se objevují modely typu směsi expertů (MoE), které umí efektivně šetřit výpočetní výkon tím, že pro každý token aktivují jen podmnožinu parametrů.

Qwen 3.6 35B A3B

Vlajkový MoE model od Alibaba nabízí celkově 35 miliard parametrů, ale aktivních je při inference pouze 3 miliardy. Díky tomu v kvantizaci UD-IQ4_NL zabere na GPU jen 16,80 GB a přitom nabízí kontext 262 tisíc tokenů. Autor přehledu ho označuje za nejlepší model pro logické úvahy v této paměťové třídě, který významně zlepšuje výsledky na matematických benchmarkech jako GPQA nebo AIME oproti předchozí generaci.

GPT-OSS 20B

Nejmenší zástupce této třídy, ale o to zajímavější. OpenAI vydala tento model jako otevřenou váhu (open-weight) ve formátu MXFP4, což je relativně nový numerický formát. Zabere pouhých 12,85 GB, takže se vejde i na unified-memory systémy s rezervou. Má kontext 128 tisíc tokenů a podle přehledu jde o skvělý model pro obecný chat a dlouhé konverzace. Je také výbornou volbou pro začátečníky, kteří nechtějí zabírat celou paměť grafiky jediným modelem.

Gemma 4 26B A4B

Google nabízí i řidší (sparse) verzi Gemmy 4 s celkovými 26 miliardami parametrů, z nichž je aktivních 4 miliardy. Její hlavní přednost je rychlost — aktivních parametrů na token je méně, takže inference probíhá rychleji než u hustých modelů podobné velikosti. Na GPU zabere 17,48 GB, na unified memory 15,92 GB. Je ideální pro dlouhé agentní smyčky a nástrojové použití, kdy model opakovaně volá funkce a pracuje s externími daty.

Co to znamená pro českého uživatele?

Pro běžného zájemce o umělou inteligenci v České republice má tento přehled konkrétní dopady. RTX 4090 s 24 GB VRAM se dnes na českém trhu prodává okolo 45 až 55 tisíc korun (cena se liší podle výrobce a aktuálního kurzu). Je to sice investice, ale stále výrazně méně než roční předplatné cloudových API pro intenzivní použití. Pokud preferujete ekosystém Apple, Mac mini M4 Pro s 24 GB unified memory začíná na zhruba 35 tisících korun a nabízí tichý provoz s minimální spotřebou energie.

Software pro běh těchto modelů je dnes dostupný zdarma. Ollama je nejjednodušší cesta — stačí jeden příkaz v terminálu a model se stáhne i nakonfiguruje samostatně. Pro ty, kteří preferují grafické rozhraní, existuje LM Studio nebo Jan, které umožňují stahovat modely z Hugging Face a chatovat s nimi lokálně. Pro pokročilé uživatele je tu llama.cpp nebo koboldcpp, které nabízejí maximální kontrolu nad kvantizací a parametry inference.

Všechny zmíněné modely — Qwen, Mistral i Gemma — jsou multilingvní a češtinu ovládají na velmi slušné úrovni. Sice nedosahují kvalit největších proprietárních modelů jako GPT-4.5 nebo Gemini 2.5 Pro v překladu složitých právních textů, ale na běžnou komunikaci, psaní e-mailů, analýzu dokumentů nebo programování jsou více než dostačující. A hlavně: běží lokálně, data neopouštějí váš počítač a neplatíte za tokeny.

Jak vybrat model podle účelu?

Autor přehledu na jeho konci nabízí jasnou radu. Pokud chcete jen jeden model na všechno, zvolte Qwen 3.6 27B ve verzi Q5_K_S (na GPU) nebo Q4_K_M (na unified memory). Je to podle něj nejuniverzálnější volba v této třídě. Pokud potřebujete čistý denní pomocník bez kompromisů, sáhněte po Mistral Small 3.2 24B. Pro psaní a jazykovou práci je ideální Gemma 4 31B.

V oblasti logických úvah vede Qwen 3.6 35B A3B na grafice s dedikovanou pamětí, zatímco na Macu s unified memory je lepší volba GPT-OSS 20B, který se vejde bez kompromisů. Programátoři by měli sledovat samostatnou kategorii Class C (Coder), která v přehledu zahrnuje specializované modely jako Qwen 3 Coder 30B A3B.

Závěr

Shrnutí od @gkisokay dokazuje, že 24 GB je dnes vstupenka do světa skutečně velkých lokálních modelů. Ještě před dvěma lety by si hobby vývojář mohl doma rozběhnout maximálně modely s 7 až 13 miliardami parametrů. Dnes má na dosah ruky 27B až 35B modely, které se kvalitou blíží cloudovým službám z předchozí generace. A to vše bez nutnosti odesílat svá data na cizí servery.

Pro českou komunitu je to pozvánka k experimentování. Ať už jste vývojář, student, novinář nebo jen zvědavý nadšenec, nástroje jsou dnes dostupné, modely jsou zdarma a hardware, který to vše utáhne, se vejde pod stůl.

Potřebuji na lokální běh LLM nutně grafickou kartu, nebo stačí procesor?

Grafická karta s dostatečnou VRAM je výrazně rychlejší, ale modely lze rozběhnout i na procesoru. S 24 GB systémové RAM a CPU inference budete čekat na odpověď desítky sekund místo několika sekund. Pro reálné použití se vyplatí investice do GPU nebo Macu s Apple Silicon.

Jaký je rozdíl mezi kvantizacemi Q4_K_M a Q5_K_S?

Q5_K_S používá 5bitovou přesnost a obvykle zachovává o něco více kvality než Q4_K_M, která používá 4 bity. Na druhou stranu Q4_K_M zabírá méně paměti. Pro běžný chat je rozdíl často nepoznatelný, u matematických úloh a kódování se může projevit drobný pokles přesnosti u Q4.

Musím platit za používání Qwen, Mistral nebo Gemma, když je spustím lokálně?

Ne. Všechny zmíněné modely mají otevřené váhy a při lokálním běhu neplatíte žádné poplatky. Jediné náklady jsou pořizovací cena hardware a elektřina. Výjimkou by bylo komerční využití u některých licencí, ale pro osobní použití jsou plně zdarma.