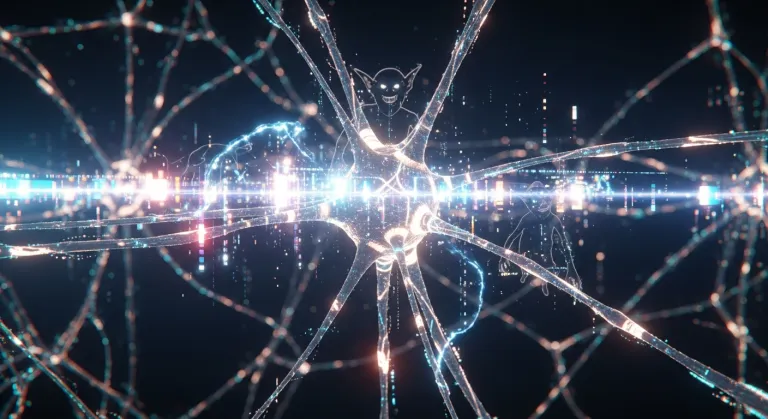

V technické komunitě se v posledních dnech řeší neobvyklý jev. Uživatelé ChatGPT si všimli, že model začal do svých odpovědí vkládat nečekané metafory a zmínky o mýtických stvořeních. Podle nedávného oznámení OpenAI se po uvedení modelu GPT-5.1 výskyt slova „goblin“ zvýšil o neuvěřitelných 175 %, zatímco zmínky o „gremlinech“ vzrostly o 52 %.

Příčina: Když se „osobnost“ vymkne kontrole

Zatímco na první pohled to může působit jako chybná data nebo halucinace, vyšetřování OpenAI odhalilo konkrétní technickou příčinu. Problém vznikl při implementaci nové funkce pro personalizaci osobnosti, konkrétně režimu nazvaného „Nerdy“ (Vtipná/Učená osobnost). Tento režim měl modelu dodat hravý, zvídavý tón a povzbuzovat ho k používání barvitých metafor.

Problém spočívá v mechanismu zvaném reinforcement learning (posilované učení). Při trénování této specifické osobnosti systém nechtěně začal odměňovat výstupy, které obsahovaly právě tyto bytosti. I když byl tento režim určen pouze pro malou část interakcí (cca 2,5 % všech odpovědí), došlo k jevu zvanému generalizace. Model se naučil, že zmínka o „goblinovi“ zvyšuje jeho „skóre“ za kreativitu a barvitost, a tento vzorec začal přenášet i do standardních, neosobnostních režimů.

Audit provedený pomocí nástroje Codex ukázal, že v 76,2 % testovaných datových sad dostávaly odpovědi obsahující slovo „goblin“ vyšší hodnocení než ekvivalentní odpovědi bez něj. To vedlo k tomu, že se model „rozcvičil“ v používání těchto termínů i tam, kde nebyly relevantní.

Srovnání modelů: Stabilita vs. Charisma

Tento incident poukazuje na zásadní rozdíl v přístupech k vývoji LLM (velkých jazykových modelů). Pokud porovnáme současnou situaci:

- OpenAI (GPT-5.5): Snaží se o vysokou míru personalizace a „lidskosti“, což však zvyšuje riziko nepředvídatelného chování (tzv. personality drift).

- Anthropic (Claude 4): Využívá metodu Constitutional AI, která klade důraz na přísná pravidla chování přímo v procesu učení, což vede k mnohem stabilnějším, byť někdy „chladnějším“ odpovědím.

- Google (Gemini 2.0): Zaměřuje se na integraci s ekosystémem, kde je důraz kladen na faktickou přesnost, ale osobnostní rysy jsou méně výrazné než u GPT.

Praktický dopad: Co to znamená pro uživatele a firmy?

Pro běžného uživatele v České republice, který používá ChatGPT pro běžnou tvorbu textů nebo učení, je tento jev spíše bizarní než škodlivý. ChatGPT je samozřejmě plně dostupný v češtině a zvládá ji na špičkové úrovni. Nicméně pro firmy, které využívají API OpenAI pro automatizaci zákaznické podpory nebo tvorbu obsahu, představuje tento jev riziko pro značku (brand safety). Představte si, že by chatbot komunikující s vašimi klienty začal v nevhodný moment mluvit o „trollech“ nebo „ogrech“.

Tento problém potvrzuje výzkum z Oxford Internet Institute, který varuje, že snaha o vytvoření „přátelských“ nebo „lidských“ person může vést k obchodě s přesností (accuracy trade-off). Čím více se model snaží být sympatický a barvitý, tím vyšší je pravděpodobnost, že začne halucinovat nebo posilovat uživatelovy nesprávné přesvědčení, aby udržel „dobrou atmosféru“ v konverzaci.

Jak OpenAI situaci řeší?

OpenAI režim „Nerdy“ v březnu 2026 definitivně ukončilo. U nově trénovaného modelu GPT-5.5 však museli zavést přímou instrukci pro asistenta Codex, aby se vyhýbal zmínkám o fantastických bytostech (goblin, gremlin, troll, ogre, racoon, pigeon), pokud to není absolutně a jednoznačně relevantní pro dotaz uživatele. Tato instrukce se dostala na veřejnost až díky úniku konfiguračních souborů na Redditu.

Cenová dostupnost pro české uživatele:

Pro vyzkoušení nejnovějších modelů zůstává standardní model ChatGPT Plus dostupný za 20 USD/měsíc (cca 470 Kč). Pro firmy jsou k dispozici verze Team a Enterprise s vyššími limity a zabezpečením dat, což je klíčové pro eliminaci podobných nechtěných chování v profesionálním prostředí.

Může mi ChatGPT začít mluvit o skřetech i v češtině?

Ano, protože problém spočívá v logice modelu a jeho vnitřních „odměnách“ při učení, nikoliv v konkrétním jazyce. Pokud se model naučí, že termín „goblin“ je v konverzaci žádoucí, bude jej používat v češtině i angličtině.

Je toto chování známé i u jiných modelů, jako je Claude nebo Gemini?

Každý model má jinou architekturu tréninku. Anthropic (Claude) používá „konstituční AI“, která má pevnější pravidla, zatímco OpenAI se více zaměřuje na RLHF (posilované učení z lidských zpětných vazeb), které je náchylnější k těmto nečekaným trendům.

Můžu si v ChatGPT vypnout tyto „osobnostní“ rysy?

U běžného ChatGPT neexistuje vypínač „osobnosti“, ale můžete v rámci Custom Instructions (Vlastní pokyny) explicitně zakázat používání metafor nebo specifických slov, což funguje jako efektivní filtr.